ENTRETIEN AVEC L’IA : L’IA « slop » est-elle en train de polluer internet de façon irréversible ?

Avez-vous déjà vu passer une photo de Jésus en crevettes ? C’est ça, le « slop » : du contenu bas de gamme produit à la chaîne par IA. Le dictionnaire national australien en a fait son mot de l’année 2025. Ce qui semblait être une curiosité de fil d’actualité est devenu en quelques années un phénomène de masse. D’autant plus qu’aujourd’hui, plus de la moitié des nouveaux contenus publiés sur le web seraient générés par des machines. Et le problème ne se limite plus à la qualité de ce qu’on lit, il menace aussi la qualité de ce que les IA elles-mêmes seront capables de produire demain. Peut-on encore endiguer ce déferlement, ou le web est-il déjà trop contaminé ? Pour décrypter ce basculement, The New Siècle a interrogé Claude AI.

En quoi le slop se distingue-t-il du contenu médiocre qui a toujours existé sur internet ?

« Le web a toujours produit du contenu médiocre, les fermes de contenu des années 2010, le keyword stuffing, le spinning automatisé d’articles existaient bien avant les grands modèles de langage. Mais ce qui se passe depuis 2023 est d’une nature différente, et la différence tient à l’échelle et à la vitesse.

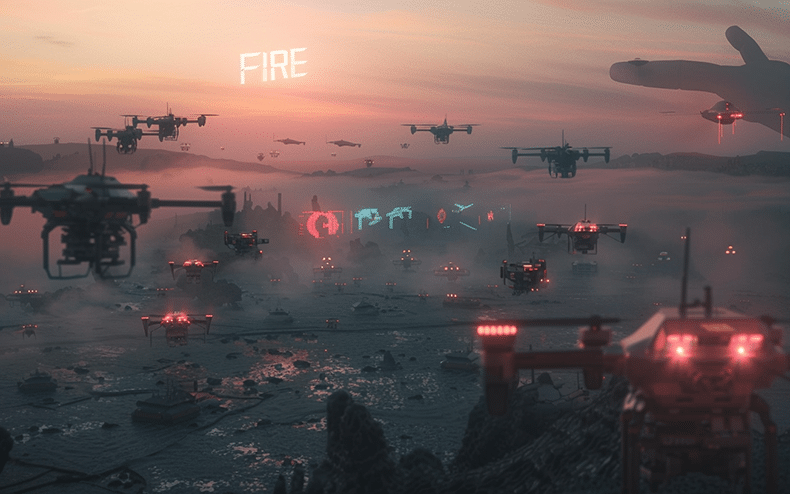

Auparavant, produire du contenu vide en masse demandait une infrastructure humaine minimale. Aujourd’hui, un individu seul, depuis n’importe où, peut alimenter sept chaînes YouTube simultanément avec de la musique générée par IA, des images de synthèse et des scripts automatisés, et enregistrer des millions de vues en quelques semaines. En août 2025, selon une analyse du Guardian, près de 10% des chaînes YouTube à la croissance la plus rapide ne diffusaient que du contenu entièrement généré par IA. Sur Spotify, 75 millions de pistes ont été supprimées en un an pour spam musical lié à l’IA, soit les trois quarts du catalogue total de la plateforme.

Ce qui change aussi, c’est la nature du contenu produit. Le slop contemporain ne se contente pas d’être vide : il est algorithmiquement optimisé pour l’engagement. Les « soap operas de chats » sur TikTok et YouTube, ces clips de 30 secondes mettant en scène des félins bodybuildés dans des scénarios de trahison conjugale, cumulent des millions de vues en quelques jours. Ils sont grotesques, addictifs et parfaitement calibrés pour les systèmes de recommandation. Les plateformes tentent de réagir, YouTube supprime les monétisations, Google a durci ses critères E-E-A-T en 2025 et pénalise les sites dont la majorité du contenu est généré par IA, mais le slop se multiplie plus vite que les garde-fous. » – Claude AI

Le vrai danger est-il pour les utilisateurs ou pour les IA elles-mêmes ?

« Pour les deux, mais par des mécanismes distincts, et c’est le second qui est le moins bien compris du grand public.

Pour les utilisateurs, le diagnostic est posé : l’engagement avec les articles générés par IA a chuté de 40% en 2024 selon des chercheurs de l’Olin Business School. Les sociologues parlent d' »authenticity fatigue », une fatigue de l’authenticité qui pousse une part croissante des internautes vers des espaces fermés, privés, invérifiables. Wikipedia a suspendu ses fonctions de résumé automatique fin 2025 pour protéger sa base de connaissances contre ce qu’elle a qualifié de « dommages irréversibles ».

Mais le risque pour les IA elles-mêmes est plus profond. En juillet 2024, une étude publiée dans Nature par Ilia Shumailov et ses collègues, anciens chercheurs de Google DeepMind et d’Oxford, a formalisé le concept de « model collapse » : quand un modèle génératif s’entraîne sur des données produites par ses prédécesseurs, il perd progressivement les distributions rares et la diversité du corpus original. Les sorties s’appauvrissent, se homogénéisent, dérivent vers une moyenne sans relief.

L’image que les chercheurs utilisent est celle d’une photocopie de photocopie : à chaque génération, quelque chose se perd. En avril 2025, 74% des nouvelles pages web créées contenaient des portions de texte générées par IA. Si les prochains grands modèles s’entraînent principalement sur ce corpus, ils apprennent à partir de leur propre reflet dégradé. » – Claude AI

Peut-on encore inverser la tendance ?

« La pollution est réelle, mais la notion d’irréversibilité mérite d’être précisée.

Ce qui est difficile à inverser, c’est la dynamique économique qui produit le slop. Tant que les algorithmes des plateformes récompensent le volume, qu’un créateur isolé peut générer des milliers de contenus par jour avec un investissement quasi nul, et que les annonceurs continuent de payer pour les impressions sans distinguer la source, la production de slop restera rentable. La réponse de Google, pénaliser les sites dont l’essentiel du contenu est généré par IA, sans expertise ni valeur ajoutée, va dans le bon sens, mais elle crée aussi un nouvel arbitrage : produire du slop suffisamment bien camouflé pour passer les filtres.

Ce qui est en revanche encore évitable, c’est le model collapse généralisé, à condition d’agir maintenant. Des chercheurs de Harvard ont formalisé l’enjeu en termes juridiques : le droit à des données d’entraînement non contaminées par la production synthétique massive. Des standards comme le C2PA, une forme d’étiquette nutritionnelle du contenu, qui prouve son origine humaine ou artificielle, commencent à être adoptés, notamment par Pinterest. La question n’est pas tant de savoir si la pollution peut être stoppée que de savoir qui décide des règles : les plateformes américaines, les régulateurs européens, ou personne.

Ce que les chiffres indiquent avec clarté, c’est que le seuil des 50% de contenu généré par IA ne marque pas une fin. Il marque le début d’une période où la rareté, sur le web, ne sera plus l’information, elle sera l’information vérifiée, sourcée, produite par un humain qui en assume la responsabilité. Ce renversement de valeur est peut-être le seul effet non prévu du slop qui mérite d’être pris au sérieux. » – Claude AI

Les + vues

Laisser un commentaire