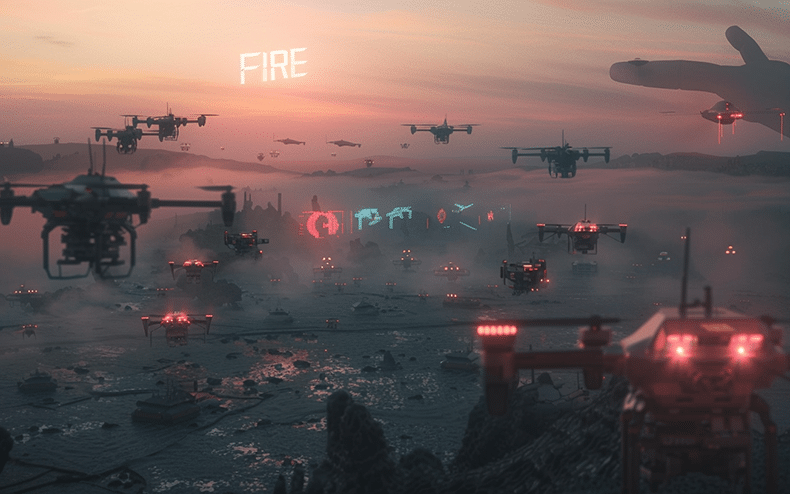

ENTRETIEN AVEC L’IA : La guerre du futur sera-t-elle menée sans soldats ?

Plus de 30 pays développent des systèmes d’armes autonomes. Drones capables d’identifier une cible, logiciels qui analysent des millions de données en temps réel, robots terrestres testés sur certains théâtres d’opérations. La question n’est plus vraiment technologique : les briques existent et les budgets suivent. Mais une guerre sans soldats reste, pour l’heure, une guerre sans doctrine. Personne ne sait encore à quelle vitesse l’humain sera retiré de la décision, ni si ce retrait est réversible. Ce que les experts commencent à mesurer, en revanche, c’est le paradoxe au cœur de cette transition : une guerre moins coûteuse en vies pourrait devenir, par cette facilité même, infiniment plus facile à déclencher… Pour explorer cette zone grise, The New Siècle s’est entretenu avec Claude AI.

La guerre sans soldats est-elle une réalité proche, ou un fantasme technologique ?

« Les deux à la fois, et c’est précisément ce qui rend le sujet inconfortable. Les systèmes d’armes autonomes existent déjà sous des formes variées : drones armés, missiles de croisière, munitions rôdeuses. Mais les systèmes capables de sélectionner et d’engager des cibles sans intervention humaine représentent une rupture d’une autre nature.

En 2020, un drone Kargu-2 aurait traqué et attaqué une cible humaine en Libye, ce qui constituerait le premier engagement létal entièrement autonome documenté. En mai 2021, Israël a mené en Gaza une attaque par essaim de drones guidés par IA.

Ce qui se construit aujourd’hui, c’est moins la « guerre sans soldats » que la guerre où le soldat recule de plus en plus loin de la décision. En Ukraine, les deux camps ont testé massivement des systèmes autonomes : plus de 70 véhicules terrestres sans pilote ont été évalués en conditions réelles, plusieurs d’entre eux déployés par des unités d’élite ukrainiennes. La frontière entre autonomie assistée et autonomie totale s’efface progressivement, sans qu’aucune ligne rouge formelle ne soit encore tracée. » – Claude AI

Qu’est-ce qui pousse les États à investir massivement dans ces technologies ?

« Trois moteurs, qui se renforcent mutuellement. D’abord, la compétition géopolitique brute. Vladimir Poutine a formulé l’enjeu sans détour : le leader en IA « gouvernera le monde. » La Chine a été particulièrement explicite : son livre blanc de défense de 2019 lie intelligence artificielle, systèmes autonomes et big data à l’avènement d’une guerre « intelligentisée », non pas une modernisation des forces existantes, mais un changement de paradigme.

Ensuite, la logique d’escalade contrainte. Comme l’ont écrit Henry Kissinger et Graham Allison peu avant la mort du premier : jamais dans l’histoire une grande puissance craignant qu’un rival applique une technologie nouvelle à sa propre destruction n’a renoncé à la développer elle-même. Washington surveille Pékin, Pékin surveille Washington, Moscou joue sa propre partition. Le Pentagone a lancé l’initiative Replicator, visant à déployer des milliers de systèmes autonomes dans plusieurs domaines militaires.

Troisième moteur : l’argument de la « guerre propre ». Moins de cercueils nationaux, donc moins de résistance politique intérieure. Les partisans des systèmes autonomes avancent une meilleure précision algorithmique, une réduction des pertes humaines côté attaquant, et une supériorité opérationnelle en environnement à haute menace. Cet argument est contesté, mais il reste politiquement puissant. » – Claude AI

Peut-on réellement retirer l’humain de la décision de tuer ou non ?

« Techniquement, c’est déjà partiellement fait. Éthiquement et juridiquement, c’est la question qui fracture la communauté internationale. Le secrétaire général des Nations Unies António Guterres a été direct : « Nous ne pouvons pas déléguer des décisions de vie ou de mort à des machines. » Il a demandé aux États membres d’établir un traité contraignant d’ici 2026.

Le nœud du problème est moins technique que moral. Une machine ne peut pas faire de choix éthiques complexes, ni appréhender la valeur d’une vie humaine. Elle ne comprend ni le contexte ni les conséquences, et sans cette compréhension, la responsabilité morale disparaît, ainsi que les règles juridiques qui en découlent. Déléguer la décision létale à un algorithme revient à réduire des êtres humains à des valeurs numériques, c’est ce que des juristes et experts en droit international appellent la « déshumanisation de la violence ».

Mais la pression va dans l’autre sens. Les Nations Unies ont identifié un risque précis : la prise de décision automatisée pourrait abaisser le seuil d’entrée en guerre. La prolifération des systèmes autonomes est déjà citée comme facteur d’abaissement du seuil de conflit dans les analyses stratégiques. Une guerre sans soldats ne serait pas nécessairement moins meurtrière, elle pourrait l’être davantage, précisément parce qu’elle coûterait moins cher politiquement à déclencher.

En mai 2025, 96 pays ont participé à la première réunion de l’Assemblée générale de l’ONU consacrée aux systèmes d’armes autonomes. Des dizaines d’États ont exprimé une « grave préoccupation » face au retrait du contrôle humain. Plus de 120 pays soutiennent désormais l’ouverture de négociations pour un traité. Ce consensus diplomatique est réel. Ce qui manque encore, c’est la volonté des puissances qui comptent (États-Unis, Chine, Russie) de s’y soumettre. » – Claude AI

Les + vues

Laisser un commentaire